울산과학기술원(UNIST)은 인공지능대학원 한승열 교수팀의 연구 성과 논문 3편이 오는 23일 브라질 리우데자네이루에서 열리는 표현학습국제학회(ICLR)에 채택됐다고 21일 밝혔다. ICLR은 신경정보처리시스템학회(NeurIPS), 국제머신러닝학회(ICML)와 함께 세계 3대 AI 학회로 꼽힌다.

|

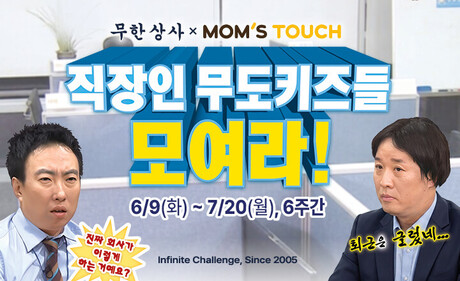

| ▲ 왼쪽부터 한승열 교수와 각 연구의 제1저자인 이상현·황재박·조용현 연구원. [울산과학기술원 제공] |

최상위 AI 학회의 경우 심사 기준이 까다로워 단일 연구실에서 3편의 논문이 동시에 채택된 것은 드문 사례다. 실제 올해 ICLR에는 전 세계에서 1만9000여 편의 논문이 제출됐으며, 이 중 약 27%인 5300여 편만이 심사를 통과했다.

이번 성과는 모두 강화학습 분야에서 나왔다. 강화학습은 AI가 환경과 상호작용하며 시행착오를 통해 최적의 행동을 스스로 찾아내는 학습 방식으로, 피지컬 AI 시대의 필수 기술로 꼽히고 있다.

한 교수팀의 첫 번째 성과는 산업 현장에서 바로 수집한 오프라인 데이터로도 인공지능을 효과적으로 학습시킬 수 있는 '자기 개선 스킬 학습법'(SISL)이다.

스킬은 복잡하고 긴 작업을 효율적으로 해결하기 위해 로봇 등의 연속적인 행동을 재사용 가능한 여러 세부 단위로 나눈 것이다. SISL은 더 유용한 스킬을 능동적으로 발견하고, 모델 내의 노이즈를 지속적으로 제거해 오류가 섞인 데이터로도 높은 작업 성공률을 유지할 수 있다.

복잡하고 긴 작업의 성공률을 높일 수 있는 기술도 내놨다. 강화학습은 과업이 복잡할 경우 목표를 여러 개의 하위 단위로 쪼개 수행하는데, 문제는 로봇이 물리적으로 도달할 수 없는 잘못된 하위 목표를 설정할 경우 전체 학습 효율이 떨어진다는 점이다. 연구팀은 실패한 시도와 부분적으로 성공한 데이터를 분석해 도달 가능한 목표를 명확히 구분하는 '엄격한 하위 목표 실행(SSE)' 학습기술을 개발해 이 문제를 해결했다.

군집비행과 같이 여러 AI 에이전트들이 협력해야 하는 상황에서 발생하는 최적화 문제를 해결할 수 있는 해법도 제시했다. 다중 에이전트 강화학습(MARL) 환경에서 훈련 중 상황이 변해 최적의 행동 기준이 달라질 때 AI가 차선책에만 머무르는 현상을 극복한 성과다. 연구팀은 하나의 최적 행동에만 의존하던 기존 알고리즘의 단점을 보완해, 여러 대안적 행동 가치를 동시에 기억하고 평가하는 '연속적 하위 가치 Q-러닝(S2Q)' 기술을 개발했다.

한승열 교수는 "이번 연구는 제한된 데이터와 불확실한 환경에서도 강화학습을 안정적으로 적용할 수 있는 가능성을 보여준 것"이라며 "자율주행, 로봇, 스마트 제조 등 다양한 분야로의 확장이 기대된다"고 말했다.

이번 연구에는 이상현·황재박·조용현 연구원이 제1저자로 각각 참여했다. 연구수행은 과기부 정보통신기획평가원의 '자율드론상용화 과제 지향 강화학습 핵심기술 개발' 'AI 스타 펠로우십 프로그램' '인공지능대학원 지원 사업'과 한국연구재단의 '대규모 자율군집제어 End-to-End 기술 개발 사업'의 지원을 받아 이뤄졌다.

KPI뉴스 / 최재호 기자 choijh1992@kpinews.kr

[저작권자ⓒ KPI뉴스. 무단전재-재배포 금지]